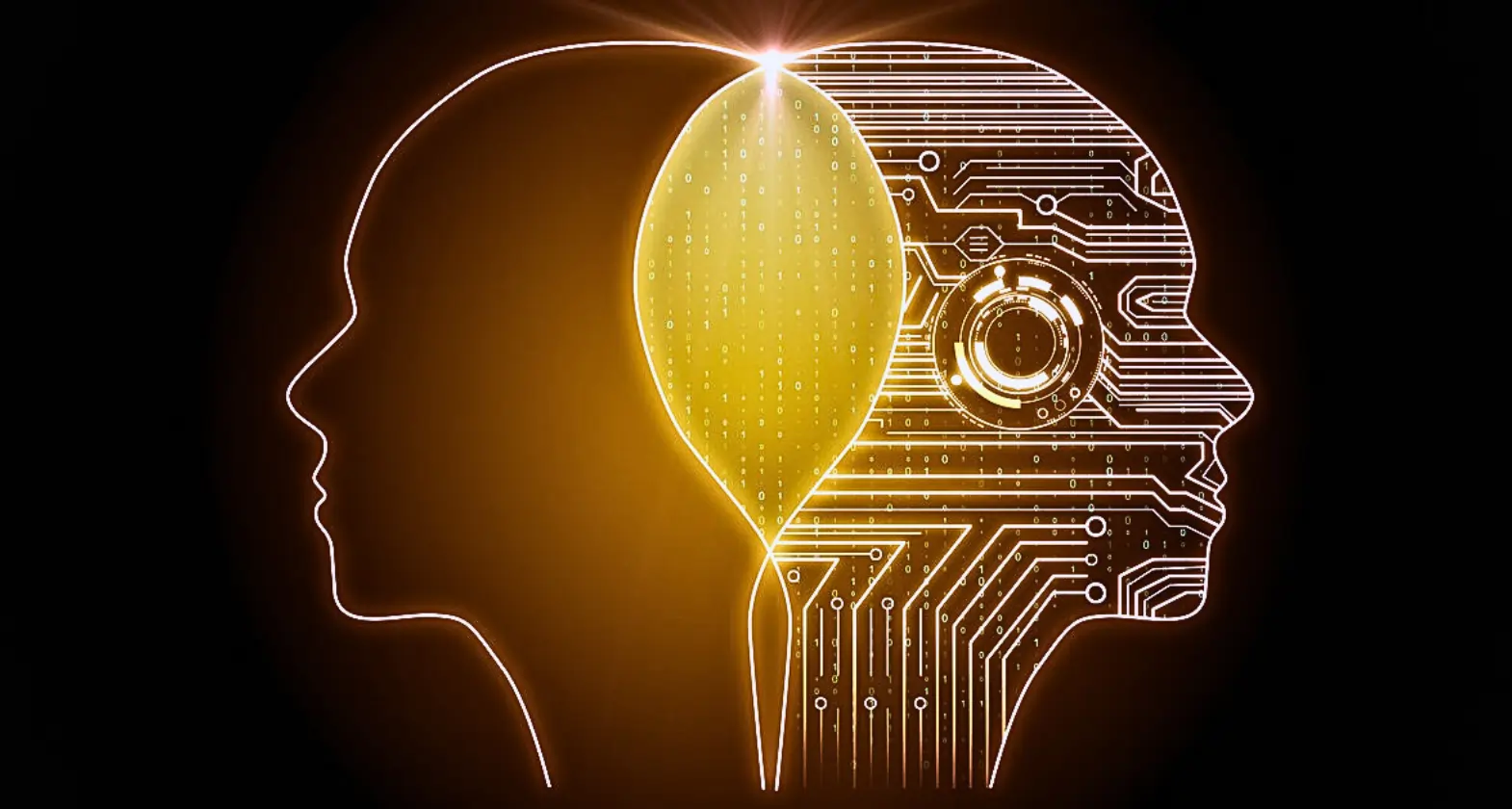

सध्या टेक्नॉलॉजीच्या जगात 'सोरा' नावाच्या एका एआय टूलची चर्चा आहे. ते ओपनएआय या कंपनीने बनवलं आहे. आपण फक्त काही ओळींमध्ये आपल्याला काय हवं आहे ते तिथे लिहायचं, आणि 'सोरा' त्याप्रमाणे अगदी खरा वाटणारा व्हिडिओ तयार करून देते. उदाहरणार्थ, 'एक सोनेरी रंगाचा कुत्रा बर्फात खेळतो आहे' असं लिहिलं, तर काही मिनिटांत तसा हुबेहूब व्हिडिओ आपल्यासमोर तयार होतो. वरवर रंजक आणि निरुपद्रवी वाटणारं हे तंत्रज्ञान किती नुकसानकारक ठरू शकतं हे हळूहळू लक्षात यायला लागलं आहे.

या तंत्रज्ञानाचा वापर करून काही लोकांनी मृत लोकांचे व्हिडिओ बनवले. जे कलाकार आज जिवंतच नाहीत, ते पडद्यावर पुन्हा बोलू लागले, वावरू लागले. एका बाजूला अशा व्हिडीओजने त्यांच्या आठवणींना उजाळा मिळू शकतो, पण दुसऱ्या बाजूला त्यांच्या प्रतिमेचा गैरवापर होण्याचा धोकाही यात आहे. या तंत्रज्ञानामुळे आता कोणाचाही चेहरा वापरून, त्याला काहीही बोलताना दाखवणारे 'डीपफेक' व्हिडिओ बनवणं अगदी सोपं झालं आहे. हे तंत्रज्ञान मुक्तपणे उपलब्ध आहे ही चांगली गोष्ट आहे पण त्याचं काही नियमन नसल्यामुळे ते दिशाहीन आणि उपद्रवी होण्याची शक्यता आहे.

काही महिन्यांपूर्वी पोप फ्रान्सिस यांचा एक फोटो जगभर व्हायरल झाला. त्यात त्यांनी एक स्टायलिश पांढरं जॅकेट घातलं होतं. तो फोटो इतका खरा वाटत होता की अनेकांनी त्यावर विश्वास ठेवला. अस्वल, वाघ, साप असे प्राणी घरात, अंगणात आले आहेत, असे फेक व्हिडीओज मनोरंजन म्हणून एकवेळ फारसे धोकादायक नाहीत. पण फेक व्हिडीओजचा वापर करून आपल्या विचारांवर, आपल्या वर्तनावर प्रभाव टाकण्याचा उद्देश असेल तर? तर कठीण आहे. व्हिडीओजच्या प्रेक्षकांनी त्यापासून स्वतःचा बचाव करायचा कसा आणि खरा-खोटा व्हिडीओ ओळखायचा कसा हा प्रश्न आहे.

समजा एक नेता भाषणं करतोय, आजूबाजूला प्रचंड गर्दी आहे, असा व्हिडीओ लोकांना माध्यमांमध्ये दिसला. हा व्हिडीओ खरा नाहीय हे ओळखणं जवळजवळ अशक्य व्हावं इतका तो हुबेहूब बनवला गेलाय. या गोष्टीचा वापर करून त्या नेत्याच्या तोंडी काहीही वाक्य देता येतील. त्याला मानणारी माणसं ते व्हिडीओ बघून प्रभावित होतील, त्याप्रमाणे कृतीही करतील. हे नक्कीच धोकादायक आहे.

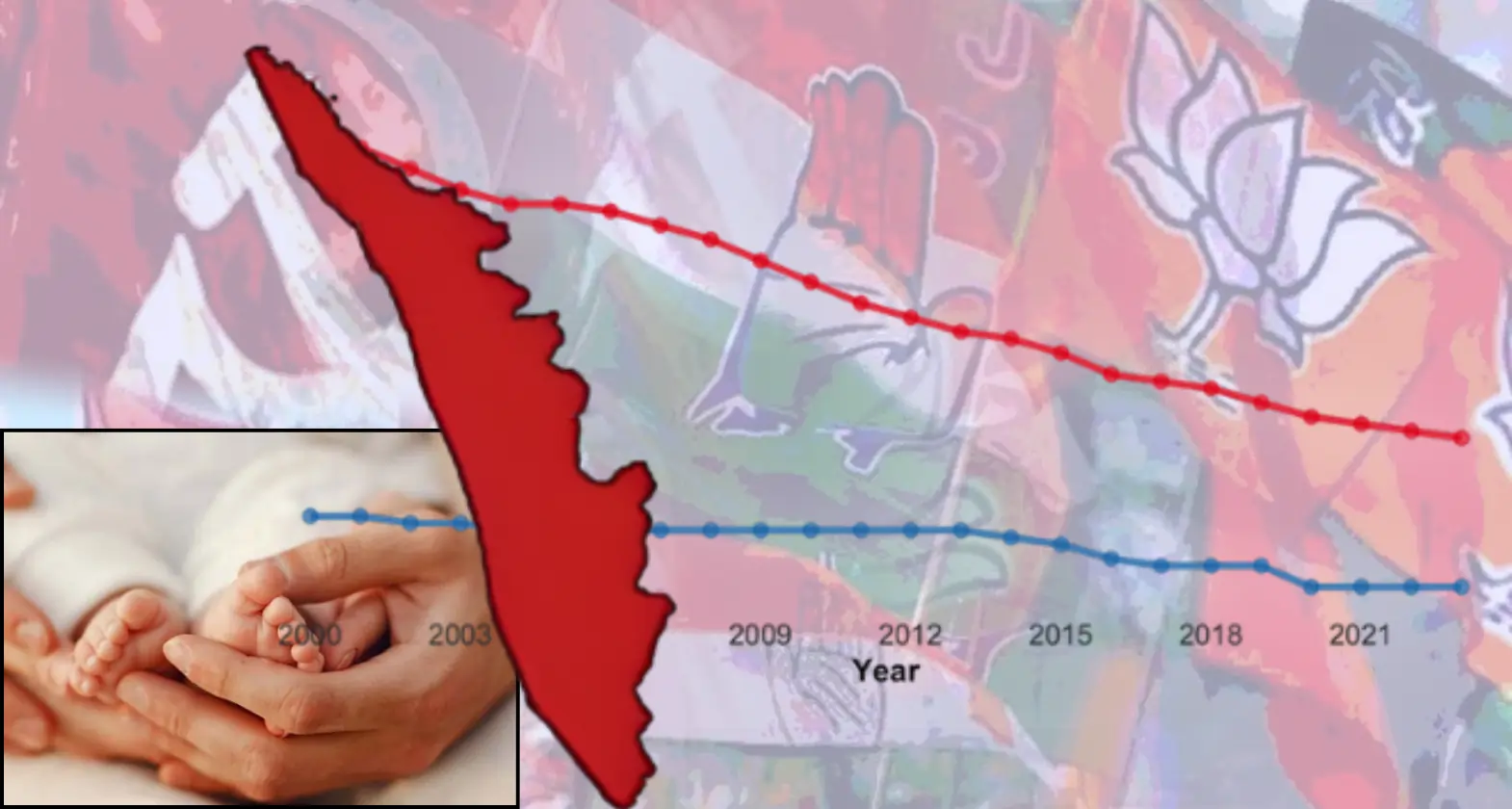

खोटी गर्दी दाखवणं तर आता खूपच सोपं झालंय. हॉलिवूड अभिनेता विल स्मिथच्या बाबतीत असंच काहीसं घडलं. एका कार्यक्रमात एआय वापरून त्याच्याभोवती खोटी गर्दी दाखवण्यात आली. अशा घटनांमुळे कोणावर विश्वास ठेवावा आणि कोणावर नाही, असा प्रश्न आहे. निवडणुकांच्या काळात तर अशा खोट्या व्हिडिओजचा आणि बातम्यांचा पाऊस पाडून मतदारांची दिशाभूलही केली जाऊ शकते.

हे वारं परदेशातून आता भारतातही येऊ लागलं आहे. तेलंगणामध्ये नुकताच जमिनीच्या वादावरून एक मोठा राजकीय गोंधळ उडाला. या प्रकरणात एआयने तयार केलेली खोटी माहिती आणि खोटे फोटो वापरण्यात आले. केंद्रीय मंत्र्यांपासून ते काही सेलिब्रिटींपर्यंत अनेकांनी ही खोटी माहिती खरीच समजून सोशल मीडियावर शेअर केली. त्यावरून बराच गोंधळ झाला. ही खोटी माहिती किती वेगाने आणि कुठेपर्यंत पोचू शकते याला काही मर्यादा नाहीयेत, हे यातून पुन्हा एकदा सिद्ध झालं.

बरं, एआयचा धोका फक्त वर्तमानकाळातच नाही, तर तो भूतकाळालाही आहे. याचं उदाहरण म्हणजे ज्यूंच्या वंशसंहाराचे खोटे फोटो तयार करण्यात आले, तेव्हाच्या काही खऱ्या फोटोजवरून व्हिडीओ बनवण्यात आले. इतिहासातली ती एक क्रूर घटना आहे. त्याचे खोटे, हसरे फोटो, व्हिडीओ तयार करणं म्हणजे त्याचं गांभीर्य कमी करण्यासारखं आणि त्याची चेष्टा करण्यासारखं आहे. ज्या कुटुंबांनी हे भोगलं आहे त्यांच्या जखमेवर मीठ चोळण्याचाच हा प्रकार आहे. उद्या आपल्या इतिहासातले फोटो आणि व्हिडीओ घेऊन नवे खोटे व्हिडीओ तयार केले जाऊ शकतात. त्यातून खोटी माहिती सहज पसरवली जाऊ शकते. गांधीजी आणि पंडित नेहरू यांच्या उपलब्ध फोटोजपासून फेक फोटोज बनवून खोटी माहिती पसरवली जाण्याच्या घटना अलीकडच्याच काही वर्षांत घडल्या आहेत. अजूनही ते फोटो माध्यमांमधून फिरत असतात आणि खऱ्या खोट्याची शहानिशा न करता लोक ते फोरवर्ड करत असतात. आता तर त्याच्या एक पाऊल पुढे जाऊन व्हिडीओ बनवणं शक्य झालं आहे. त्यात त्या माणसाचा रेकॉर्डेड आवाज उपलब्ध असेल तर तोही वापरून त्या आवाजात वेगळेच बोल त्याच्याकडून नव्या तंत्रज्ञानाच्या माध्यमातून बोलून घेतले जाऊ शकतात. म्हणजे हे दुधारी शस्त्रच बनू शकतं.

याचा आणखी एक परिणाम म्हणजे आता कुठल्याही व्हिडीओविषयी शंका निर्माण होऊ शकते. व्हिडीओ हा ताकदवान पुरावा मानला जायचा. आता त्यावरही प्रश्नचिन्हच उभं राहिलं आहे. म्हणजे कोर्टात, बातम्यांमध्ये, माध्यमांवर दाखवल्या जाणाऱ्या व्हिडीओजवर कसा विश्वास ठेवायचा? यातून एकंदर अविश्वासाचं वातावरण निर्माण होण्याची शक्यता आहे. म्हणजे खोटे व्हिडीओ खरे वाटण्याची आणि खऱ्या व्हिडीओजना सत्यअसत्यतेची परीक्षा द्यावी लागण्याची परिस्थिती आली आहे.

यावर जगभरात कायदे केले जात आहेत. पण हा एआय तंत्रज्ञानातला बदलाचा काळ आहे. त्यामुळे कायदे सुद्धा होत आणि सुधारत राहतील. तोपर्यंत आपण याला कसे बळी पडणार नाही याकडे आपण गांभीर्याने बघायला पाहिजे. आपल्या मोबाईलवर आलेला कोणताही व्हिडिओ किंवा बातमी पुढे पाठवण्याआधी आपण दहा वेळा विचार करायला पाहिजे. ही बातमी कुठून आलीय? त्याचा स्त्रोत काय आहे? ती विश्वसनीय वाटतेय का? यासारखे प्रश्न पडायला हवेत. लहान मुलांना शाळेपासूनच खरी आणि खोटी बातमी कशी ओळखावी हे शिकवायला हवं. तंत्रज्ञानाच्या आणि माध्यमांच्या बाबतीतल्या साक्षरतेवर काम होत राहायला हवं.

एआय हे एक शक्तिशाली तंत्रज्ञान आहे पण त्याचा वापर कशासाठी होईल हे वापर करणाऱ्यावर अवलंबून आहे. आज मात्र आपण अशा वळणावर उभे आहोत की खरं खोटं कळेनासं झालं आहे. ज्या तंत्रज्ञानाने खऱ्या खोट्यातला फरक धूसर केला तेच तंत्रज्ञान खरं खोटं करण्यासाठीही डेव्हलप केलं जाईल; तोपर्यंत? तोपर्यंत सावधान...

मृदगंधा दीक्षित | mrudgandha.uniqueportal@gmail.com

मृदगंधा दीक्षित युनिक फीचर्समध्ये संपादकीय विभागात कार्यरत असून त्यांना कथा-कादंबरी-कविता लिहिण्यातही रस आहे.